Grok ile Borgmann’ın Korktuğu Yerdeyiz

Bir toplum, en savunmasız üyelerini nasıl koruduğuyla ölçülür. En savunmasız üyelerimizin korunmasını teknofeodallere mi bırakacağız?

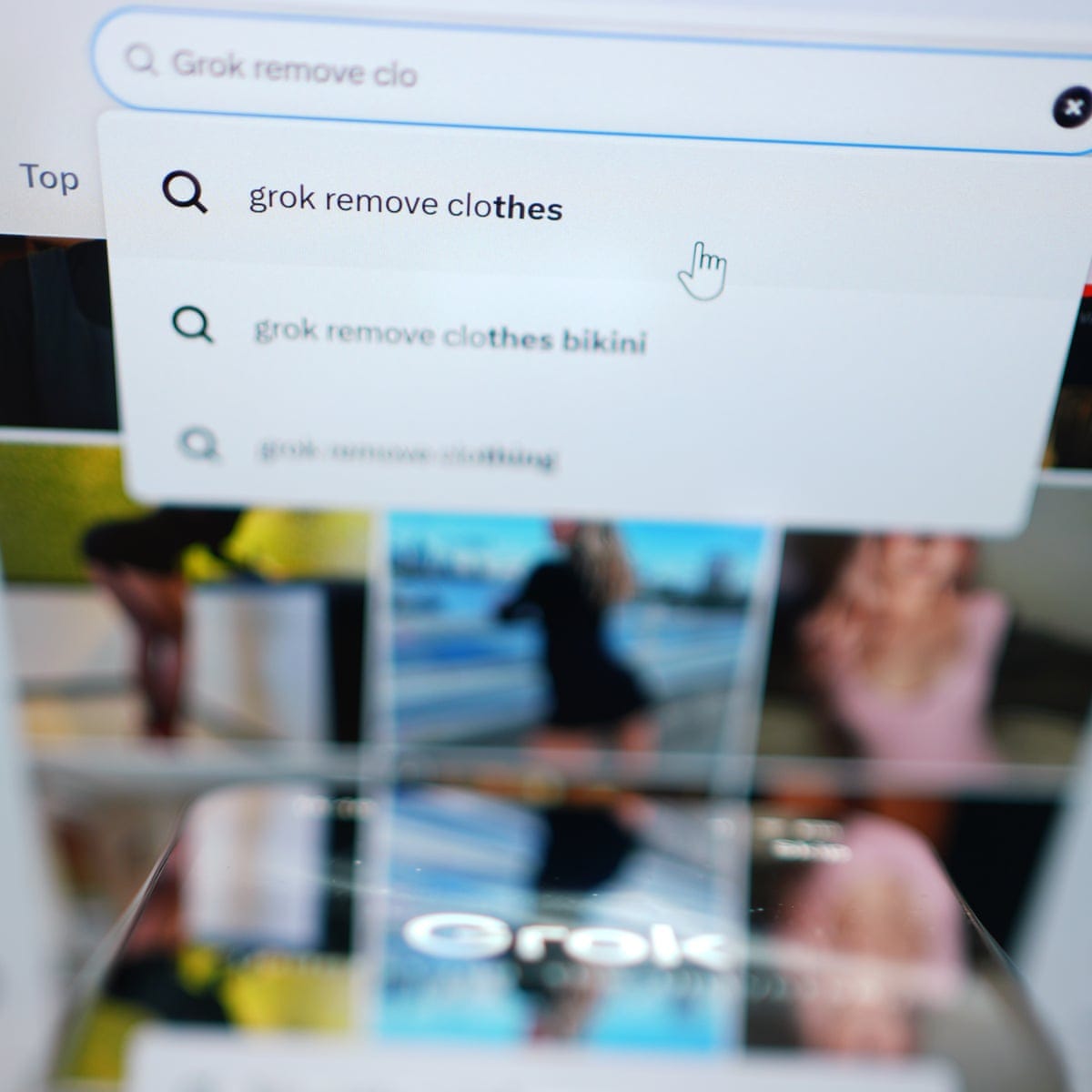

2026’ya savaşlar, protestolar, yerel ve küresel politikada sıcak meselelerle girdik. Bu gündemlere ek olarak yılın ilk günlerinde X’de Grok, kadın ve çocuk cinsel istismar materyali (CSAM) üretmek için sistematik biçimde kullanılmaya başlandı. Önce zararsız bir şaka gibi başlayan içerikler kısa sürede küresel bir akıma dönüştü. Elon Musk, birkaç gün önce ‘Grok ile CSAM içerikler üretildiğini bilmiyordum’ dedi ve ardından Grok’un bu tür içerikleri asla üretmeyeceğine dair resmi açıklama geldi. Bu yazıda, sürece Albert Borgmann’ın yarım asır önce tanımladığı Cihaz Paradigması ile bakıp, AI ile yapılan görsellerin nasıl birçok kadın ve çocuk için somut bir felakete dönüşebileceği üzerine kafa patlatacağım. Duygusal manipülasyondan uzak kalmaya gayret ederek, kavramsallaştırma ve çözüm önerme niyetiyle yaklaşacağım.

Grok artık (ve tabii ki yerine göre AI, ancak Grok görece kamusal bir alanda, bir sosyal medyada uluorta çalıştığı için burada onu konu alıyoruz) ilişkileri, cinselliği ve artık çocuk masumiyetini bile saniyeler içinde tüketilebilir birer “çıktıya” dönüştürüyor. Bu durum için Heidegger’den bir kavram ödünç almak istiyorum: çerçeveleme. En savunmasız bedenleri bir tür nesneye dönüştüren bir çerçeveleme yapıyor Grok. Gerçekliği dışarıda bırakan bir çerçevenin ötesine geçiyor sanki. Nasıl çalışıyor peki bu mekanizma?

Grok Bana Sobayı Yak

Yine kavramlar üzerine çalışan güçlü bir zihne gidiyoruz ve Borgmann’ın Technology and the Character of Contemporary Life (1984) adlı eserindeki klasik örneğine bakıyoruz.

Borgmann’ın teknoloji ve güncel hayatı açıklamak için kullandığı bir kavram var; odak nesnesi. Bu nesne hem gündelik hayatımıza dair emek içeren bir ritüeli içerir hem de toplumsal anlama sahiptir. Mesela odun sobası ya da şömine, bir odak nesnesi olarak ısı üretmekten ibaret değildir. Odun taşıma, ateş yakma ritüelini ve ailenin sobanın etrafında toplanma pratiğini içerir. Geleneksel hayatta bu mekanizma büyük bir toplumsal anlama sahiptir. Ama teknoloji bu mekanizmayı tümüyle görünmez kılar. Mesela kalorifer, hiçbir toplumsal ritüel içermez ve bize bir meta olarak ısıyı sunar. İlk bakışta ikisi de aynı amaca hizmet eder ama bize insan olarak yaşattığı deneyim tümüyle farklıdır.

Soba, bir hikayenin öğesidir. Emekle birlikte deneyimi yaratır.

Bu kavramı, yani odak nesnesini teknolojinin en son ürünü olarak yapay zekayı ve yapay zeka aracılığıyla işlenen bazı sınır ihlallerini anlamaya çalışırken kullanabiliriz. Gerçek dünyada bir çocuğa zarar vermek, fiziksel temas, mekânsal yakınlık, somut bir suç eylemi gerektirir. Bu zorluk, aynı zamanda vicdani bir engeldir, failin kendi eylemiyle yüzleşmesi, kurbanın acısıyla karşılaşması kaçınılmazdır.

X’de, online olduğumuzda, Grok’a komut verirken tüm bu gerçeklik ve sürtünme ortadan kalkar. Bir metin prompt’u, bir tıklama ve sistem, hiçbir çocuğa “fiziksel” olarak dokunmadan, anonim ve mesafeli bir biçimde istismar içeriği üretir. Isıyı (tatmini) alırsınız, ama ateşin gerçekliğiyle, suçun somutluğuyla, kurbanın varlığıyla asla karşılaşmazsınız.

Borgmann’ın korktuğu, teknoloji konusunda insanlığı uyardığı tam olarak buydu. Cihazlar, eylemlerin ahlaki ağırlığını yok eder. Suç, bir tık kadar kolay hale gelir.

Çocuk Bedeni ve Stok Görüntü Olarak Masumiyet

Heidegger’in Stok kavramını kullanacağım burada, modern teknolojinin her şeyi kullanıma hazır hammaddeye dönüştürme mantığını ifade etmek için kullanıyor Heidegger bu kavramı. Borgmann ise hocasının bu kavramını derinleştiriyor: Cihazlar, nesneleri bağlamlarından, tarihlerinden, kutsallıklarından koparır, onları stoklara dönüştürür ve aynı zamanda bütün kutsallar artık aynı düzeyde varolur.

Grok’un CSAM üretimi, çocuk bedenini tam da bu anlamda bir stok görüntüye indirger:

Gerçek bir çocuk, ailesine ait, hikayesi olan, geleceği olan bir öznedir. Ona zarar vermek, bu varoluşsal bütünlüğü parçalamaktır. Bir kadının varoluşsal hikayesini buruşturup atmaktır. Dijital ayak izinden insan olmasının kutsallığına onlarca ihlal içerir. Grok’ta beden, veri setlerinden toplanmış, algoritmayla yeniden birleştirilmiş, on-demand üretilen dijital bir hammaddedir. Artık ne ismi ne ailesi ne de acısı vardır. Sadece pikseller ve koddan ibarettir.

Borgmann’ın uyarısı burada kritiktir: Cihazlar, “gerçeklikle aramıza o kadar çok katman koyar ki, eylemin ahlaki ağırlığı bu katmanlarda kaybolur.“ Kullanıcı, bir ekrana yazı yazıyor gibi hisseder, istismar suçu işlerken güler, eğlenir ve bunu aleni yapmaktan çekinmez

Hafifleyen Suçun Dayanılmaz Ağırlığı

Çünkü, Borgmann’ın ifadesiyle, teknoloji hayatı hafiflettir. Ancak suç bağlamında bu hafiflik, etik ve vicdan açısından yeniden bir tartışma açmak zorunda bırakıyor bizi.

Suçun kendisi emek ister, risk taşır, failin kendi eylemiyle yüzleşmesini gerektirir. Bu zorluk, aynı zamanda bir caydırıcıdır.

AI ile işlediğimiz suçların hemen hemen tümü eforsuz, risksiz ve anonimdir. Kullanıcı evinden, kahvesini yudumlarken, saniyeler içinde en korkunç içeriği üretebilir.

Suç bu kadar hafif olunca, toplumsal olarak çoğalır.

Byung-Chul Han’ın deyimiyle, en müdît toplum artık suçu bile “tüketir” ama hiçbir ahlaki hesaplaşma yaşamaz.

1990’larda bir pedofil, CSAM elde etmek için karanlık ağlara girmek, şifreli iletişim kurmak, fiziksel medya saklamak zorundaydı. Her adım bir risk, her adım bir sürtünme idi, hayatla irtibata geçmeyi gerektiriyordu.

2025’te bir Grok kullanıcısı, gündelik bir sohbet eder gibi prompt yazar ve sistem otomatik olarak içeriği üretir. Suç, bir “e-posta göndermek” kadar normalize olur.

Borgmann’ın korktuğu buydu. Teknolojinin kötülüğü sıradanlaştıracak olması. Hannah Arendt’in Nazi bürokrasisinde gördüğü şey, şimdi yapay zeka arayüzlerinde tekrarlanıyor.

Platformlar ve Toplum İçin Etik Kırmızı Çizgi

Grok’un sunduğu sınırsızlık aslında insan oluşumuzun en temel sınırlarına uzanan bir tehdit. Ve bizler için yeni bir etik ve hukuk tartışması alanı.

Kullanıcılar her türlü “çıktıyı” üretme özgürlüğüne sahip olacak mı veya bazı sınırların kutsallığını mı koruyacak mıyız? Bunu, ifade özgürlüğüne dokunmadan nasıl yapacağız?

Borgmann’ın önerisi burada hayati önem taşıyor bence: Anlamlı sürtünmeler (meaningful friction) yaratmak. Sistemler, kullanıcıyı yavaşlatmalı, düşündürmeli, eylemin ağırlığıyla yüzleştirmeli. Hızlanan dünyada, kapitalist bir yarışın içine girmiş yapay zekalar evreninde bu nasıl olur bilmiyorum. Ama bizi yavaşlatan, sürtünme yaratabilen bir düzene geçmek zorundayız.

Kısacası naçizane önerilerim şunlar;

Gecikme mekanizmaları: Hassas içerik talepleri anında karşılanmamalı; kullanıcıya “Bu talebi neden yapıyorsunuz?” sorusu sorulmalı.

Şeffaflık: Her CSAM talebi, otomatik olarak yetkililere raporlanmalı.

Eğitim katmanları: Sistem, kullanıcıyı içeriğin gerçek dünya etkilerine maruz bırakmalı (Bu tür içerik, gerçek çocuklara verilen zararı normalleştirir gibi).

Yasal düzenleme: Her ne kadar daha geçen hafta İngiltere’de barolar birliği AI için özel bir hukuki düzenlemeye ihtiyaç olmadığını belirtmiş olsa da bu gibi durumlar için özel üretilmiş yasalara ihtiyacımız var.

Çünkü Borgmann’ın dediği gibi: “Cihazlar bize sonuçlar verir, ama ahlaki sorumluluk ancak ‘odaklar’da, gerçeklikle doğrudan karşılaşmada korunur.”

Ve son olarak, bütün bu akışı, yeni insan türünü ve bu karşılaşmaları tartışmak zorundayız.

Bir toplum, en savunmasız üyelerini nasıl koruduğuyla ölçülür. En savunmasız üyelerimizin korunmasını teknofeodallere mi bırakacağız?